九游 全球首个医疗视频通晓大模子开源! 6k+组精标测试集/英豪榜上线

田晏林 发自 凹非寺

手术视频的“黑盒”,被一脚踢爆了!

就在这两天,GitHub和Hugging Face社区上线了一枚医疗大模子领域的“核弹”。

全球限制最大、性能最强的医疗视频通晓大模子——uAI Nexus MedVLM(汉文名:元智医疗视频通晓大模子)开源!

最惊东说念主的是,这玩意儿是真的能看懂手术。

论文照旧被CVPR 2026收录,团队还同步甩出了一套由6245个视频-辅导对组成的设施测试集。

啥成见?医疗视频通晓,终于有了一把“全球标尺”。

而如斯兼具限制与精度的医疗视频数据开源,在业内尚属初次。

小编第一时期冲到Hugging Face,把模子拉下来实测了一波。

到底有多能打?

先嘱咐一下uAI Nexus MedVLM的硬主见:

汇注超53万条视频-辅导数据;

补助4B/7B参数限制,单卡就能部署(对,一张卡就能跑);

整合8个专科医学数据集,遁入内镜、腹腔镜、开驱散术、机器东说念主手术、照顾操作……险些你能思到的手术场景,它全包了。

实测效果咋样?

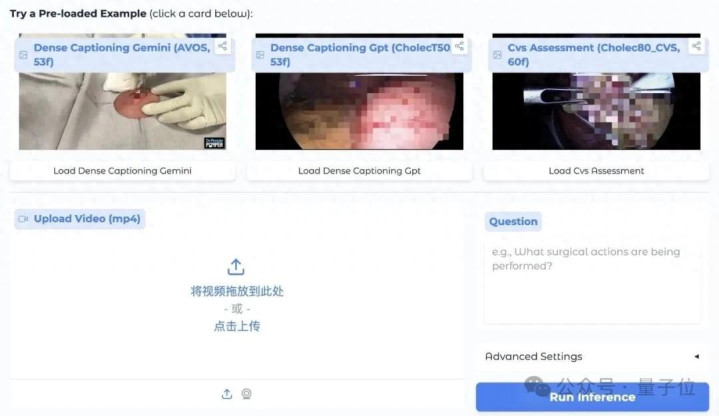

Demo的体验计划相等友好:界面中枢模块了了;补助上传手术视频文献。

你不错上传我方的医疗视频,也不错用预置示例径直测试。

我尝试用示例的腹腔镜胆囊切除术视频,测试了三个临床中枢维度,并对比了通用大模子(GPT-5.4、Gemini-3.1、某国产大模子)和uAI Nexus MedVLM的输出互异。

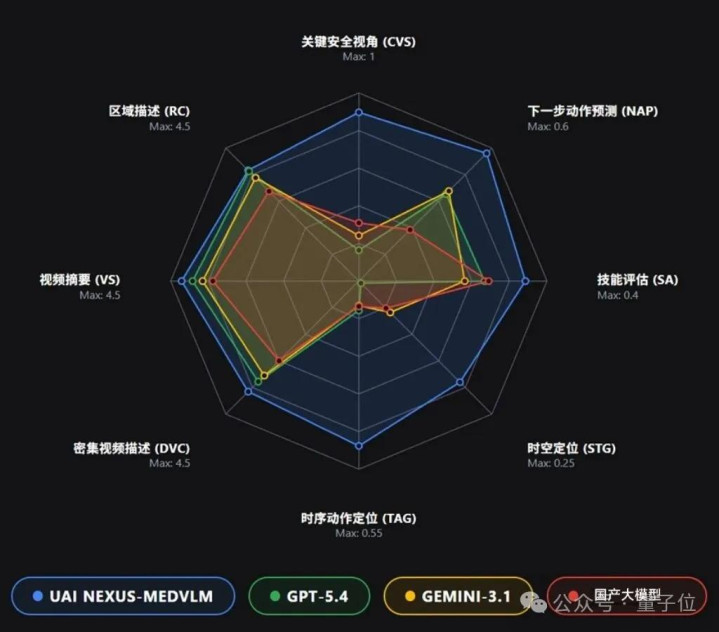

定量实测的数据太霸道了!手术安全评估:准确率89.7%。

啥成见?GPT-5.4只须16.4%,Gemini-3.1是24.2%,某国产大模子是30.9%。

也即是说,uAI Nexus MedVLM的准确率是GPT-5.4的近5.5倍,是Gemini-3.1的3.7倍,是国产大模子的近3倍。

时空看成定位:uAI Nexus MedVLM的mIoU是Gemini-3.1的3.2倍,是国产大模子的3.7倍,是GPT-5.4的47倍,

视频叙述生成(5分制):uAI Nexus MedVLM 拿到4.24分,GPT-5.4只须3.98分,某国产大模子只须3.5分,Gemini-3.1只须3.7分。

而通过MedGRPO强化学习优化后,比较基座模子,uAI Nexus MedVLM的器械定位材干擢升14%;手术要领识别材干暴涨52%;手术形色质料擢升16%~25%。

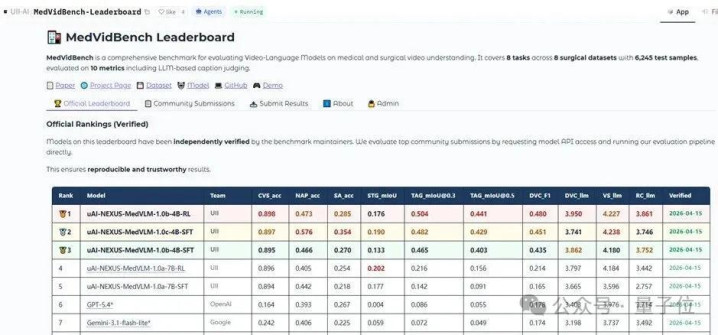

uAI Nexus MedVLM遁入内镜腔镜手术、绽放式手术、机器东说念主手术、照顾操作等多类临床场景,涵盖了8个手术数据辘集的8个任务:

视频摘抄(VS)、舛误安全视线评估(CVS)、下一步操作量度(NAP)、手段评估(SA)、时期看成定位(TAG)、密集视频形色(DVC)、区域级形色(RC)和时空基础化(STG)。

每项任务的分解齐杰出了GPT和Gemini。

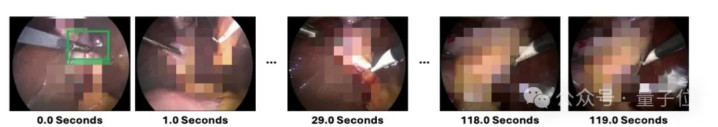

再看定性实测的限度,把一段被标志了绿色框的手术视频发给大模子,让它形色。

输入问题:你是别称专攻微创手术的外科分析众人。这段视频展示了腹腔镜胆囊切除术的内镜画面。请形色0.0秒时,规模框内物体的气象,以及在0.0~29.0秒时期段内的操作。

设施谜底是:钳接续夹持并将胆囊向手术视线的左上方牵拉,提供反向牵引和涌现。

GPT-5.4这边呢,它只可给出迟滞的形色,未能识别出具体器械。

Gemini-3.1则将器具乌有识别为“电凝钩”,形色成了不正确的操作。

某国产大模子:则无法识别出正确的手术操作要领。

只须uAI Nexus MedVLM,给出了接近设施谜底的形色:

位于左上方的持钳接续朝上并朝中央牵引胆囊,保持张力并为钩子涌现辞别平面。

随后,我看了下示例给出的8个任务分解,一个比一个令东说念主颠簸。

为幸免真实手术场景带来的不雅感不适,咱们登第了一段暖和的示例视频,内容是照管给患者监测躯壳主见。

视频涵盖了照管稽查血压计、稽查体温计、照顾记载、洗手、测量血压、测量体温、脉搏测量、呼吸测量等职责。

当前,咱们随即进修8个任务中的一个,比如「时期看成定位」。

输入问题:脉搏测量看成发生在什么时期?

设施谜底是:46.0-61.8seconds。

模子给出的量度是:43.0-65.0seconds。前后舛错不进步4秒,且正确谜底就在量度范围内。

为什么手术视频是AI最难啃的骨头?

在AI医疗领域,将AI用于影像辅助会诊、病历书写、质控解决等场景早已不是簇新事,在不少病院照旧落地。

但有一个标的,于今仍是公认的“无东说念主区”,那即是手术视频通晓。

之前没东说念主敢碰,为啥?三重地狱级难度,和静态影像十足不是一个量级:

第一关:数据极难获取。临床手术视频波及患者遁入与医学伦理,获取自身就贵重重重。

即便拿到了原始视频,你让专科医师逐帧标注?本钱高到不错劝退99%的团队。

第二关:莫得救援评测设施。这是行业里一个很莫名的现实:各家用我方的数据集、我方的主见,九游体育官网模子效果根柢没法横向比较。

你说你强,他说他强,谁说了齐不算,严重阻扰所有这个词赛说念的发展。

第三关:任务自身顶点复杂。手术视频的难就难在对空间、时序、语义的通晓要高度专科。

比如,它需要精确识别毫米级的器械位置和剖解结构。稍稍偏少许,可能就认错了。

况且胆囊得先辞别再切除,不成反过来。AI若是看不懂时序,就根柢无法通晓手术程度。

各式拘谨同样,再顶级的模子也只可歇菜。

但当前,这个无东说念主区被uAI Nexus MedVLM一脚踩穿。

它不仅仅“炫技”,是真的能救命。

好了,说点实践的。这模子具体颖慧嘛?

术前:分析主刀教诲上万台手术视频,挖掘临床轨则、辅助优化决议。

思象你是一位刚站上手术台的临床医师,行将作念一台胆结石微创手术。

过去你只可靠缅思和教诲;当前AI把盈篇满籍台顶级众人的手术教诲千里淀下来,极度于有了最强的大脑,来辅助你完成这台手术。

术中:在辞别胆囊管、泄露安全视线等舛误要领,及时给出调换;对违纪操作、看成偏差进行毫秒级预警,成为你的 “第三只眼”。

术后:自动完成追忆与结构化记载,这频繁会占用医师无数时期,但当前,一键生成设施化叙述。这台手术的教诲,也能成为下一位医师的“决策依据”。

手术质控、术中安全、叙述自动化、医学教学……uAI Nexus MedVLM的价值,远不啻于本事冲破。

在中国,优质医疗资源辘集在三甲病院,下层病院医师成长周期长、手术教诲蓄积慢。

而uAI Nexus MedVLM不错把顶级众人的手术教诲“千里淀”下来,下层病院的医师也能得到“众人级”的术中辅助。

这梗概才是AI真的通晓手术视频的意思意思场地。

全球建筑者,新机遇来了

此次发布,最值多礼贴的不仅是uAI Nexus MedVLM自身。

建筑这一模子的背后玩家联影智能(联影集团旗下一家专注于AI医疗的翻新公司),初次向全球开源大限制高质料医疗视频标注数据和模子,并提供了一个更具可比性的评测基准。

这意味着什么?终于有了一个手术视频通晓垂直领域的“全球全球测评体系”了。

过去,各家模子各说各话,效果没法比。

当前,拉出来在统一个数据集上跑一跑,谁强谁弱,一目了然。

而这,还仅仅开动。

这支研发团队不思唱独角戏,上线了医疗视频通晓大模子榜单,面向全寰宇建筑者发出挑战。

这是一个轮廓基准测试,用于评估视频言语模子在医疗和外科视频通晓方面的分解。

建筑者可提交自有模子限度,由系统基于设施自动评分,造成动态更新的救援滑行榜。

当全球建筑者齐能下载模子、使用数据集、上传我方的效果时,看谁能把对医疗视频通晓的材干规模,再往前推一步了。

这个过程中,医师上传的萧索病例、复杂手术视频,尤其是现存模子分解不及的案例,齐会成为极为稀有的真实数据,接续驱动本事迭代。

医疗视频AI正在迎来面向全球建筑者的黄金时间。

将来,uAI Nexus MedVLM将与具身智能会通,完善感知-推理-扩张的材干闭环。从手术室拓展到更多临床场景,鼓舞医疗全经过智能化。

数据绽放、模子分享、全球协同……这条路,才刚刚开动。

建筑者们,是时候上车了~

彩蛋:相聚在此,请自取

1.在线Demo: https://huggingface.co/spaces/UII-AI/MedGRPO-Demo

2.推理代码: https://github.com/UII-AI/MedGRPO-Code

3.MedVidBench数据集: https://huggingface.co/datasets/UII-AI/MedVidBench九游

OD体育(ODSports)官网入口

备案号:

备案号: